Thấy bản kế hoạch chỉn chu, Thanh Quang, giám đốc một công ty truyền thông, mừng vì nhân viên đã chủ động dùng AI, nhưng lo vì toàn bộ nội dung là tài liệu mật.

Khi rà lại tài liệu để gửi khách hàng, anh Quang bất ngờ thấy bản kế hoạch được trình bày mạch lạc, câu chữ gãy gọn, chuyên nghiệp hơn thường lệ. “Khi hỏi, cậu nhân viên mới tiết lộ AI hỗ trợ làm kế hoạch, thậm chí hào hứng kể đã ‘bắt’ AI làm việc thế nào”, anh nói.

Vui vì nhân viên biết ứng dụng công nghệ để tạo ra sản phẩm chất lượng, nhưng nỗi lo cũng ập tới. Để có bản kế hoạch chi tiết, nhân viên đã học theo mẹo trên mạng, đăng toàn bộ tệp tin về kế hoạch sắp tới, gồm cả thông tin liên quan đến khách hàng, sản phẩm sắp ra mắt, chiến lược, ngân sách cho ChatGPT. Đó đều là những thông tin phía đối tác yêu cầu bảo mật.

“Tôi không rõ ChatGPT có lưu lại không, cũng không rõ dữ liệu đó giờ ở đâu. Nhưng chắc chắn, nó không còn là bí mật chỉ hai bên biết nữa”, anh nói. “Nhân viên vẫn hồn nhiên tin rằng chỉ tiết lộ cho ChatGPT thì người ngoài không thể biết”, anh Quang cho hay.

Những trường hợp trên được gọi là Shadow AI (AI trong vùng tối) – thuật ngữ chỉ cá nhân hoặc bộ phận trong tổ chức tự ý sử dụng công cụ Trí tuệ nhân tạo mà không được sự cho phép hoặc giám sát của bộ phận công nghệ thông tin. Khái niệm này bắt nguồn từ “Shadow IT”, khi nhân viên dùng hệ thống công nghệ ngoài tầm kiểm soát chính thức.

Tính năng upload tài liệu trên ChatGPT. Ảnh: Lưu Quý

Trong bối cảnh AI tạo sinh được ứng dụng rộng rãi, Shadow AI trở thành mối lo mới với doanh nghiệp. Báo cáo về An ninh mạng năm 2025 được Cisco công bố tháng trước cho thấy 62% tổ chức tại Việt Nam thừa nhận thiếu tự tin trong việc phát hiện nhân viên sử dụng AI không qua kiểm soát, tức gặp tình trạng Shadow AI. Cũng theo khảo sát, 44% nhân viên trong tổ chức tại Việt Nam đang sử dụng công cụ GenAI từ bên thứ ba đã được phê duyệt, nhưng 40% đội ngũ CNTT không nắm được cách nhân viên tương tác với GenAI.

Thách thức Shadow AI

Từng là người khuyến khích nhân viên chủ động sử dụng AI, thậm chí mua tài khoản ChatGPT Plus cho cả phòng dùng chung, Nguyễn Hoàng, trưởng phòng kinh doanh tại một công ty khởi nghiệp tại Hà Nội, giờ lại lo lắng về việc AI bị lạm dụng.

Trong một lần xem lại lịch sử chat ở tài khoản chung, anh bất ngờ phát hiện một đoạn hội thoại dài, trong đó một nhân viên nhờ AI tư vấn cách chăm sóc khách hàng. Người này “tâm sự” với chatbot toàn bộ thông tin nhạy cảm, từ tình trạng trì trệ của một dự án lớn, phản ứng tiêu cực của khách, đến khó khăn nội bộ đang gặp phải. “Nhân viên đó giải thích rằng cần nói rõ, chatbot mới hiểu để tư vấn chính xác được”, anh kể.

Lo ngại nguy cơ xảy ra với dữ liệu công ty, nhưng anh thừa nhận vẫn loay hoay không biết cách ngăn chặn, bởi doanh nghiệp nhỏ, không thể trang bị công cụ AI với khả năng bảo mật cao hơn.

“Các nhóm an ninh mạng đang đối mặt với hai thách thức lớn: Làm thế nào để bảo mật quá trình phát triển và triển khai các ứng dụng doanh nghiệp tích hợp AI, trong khi vẫn bảo vệ nhân viên khi họ sử dụng công cụ AI của bên thứ ba”, ông Nguyễn Như Dũng, Tổng giám đốc phụ trách Cisco Lào, Việt Nam và Campuchia, đánh giá.

Còn theo ông Vũ Ngọc Sơn, Trưởng ban Nghiên cứu, tư vấn, phát triển công nghệ và Hợp tác quốc tế của Hiệp hội An ninh mạng quốc gia (NCA), Shadow AI trở thành mối lo ngại lớn về an ninh mạng, đối với cả ba trụ cột của một hệ thống công nghệ thông tin gồm: con người, quy trình và công nghệ.

Lấy ví dụ trong nhiều tổ chức, doanh nghiệp trong nước, ông Sơn cho biết đã gặp nhiều trường hợp người dùng đưa tài liệu, mã nguồn nội bộ, kế hoạch kinh doanh hoặc thông tin chiến lược, báo cáo tài chính, để nhờ AI phân tích hoặc tư vấn. “Dữ liệu sẽ được các hệ thống AI sử dụng để huấn luyện tăng cường cho AI và có khả năng sẽ bị lộ lọt nếu nền tảng AI bị tấn công, xâm nhập hoặc bảo mật kém”, ông Sơn đánh giá.

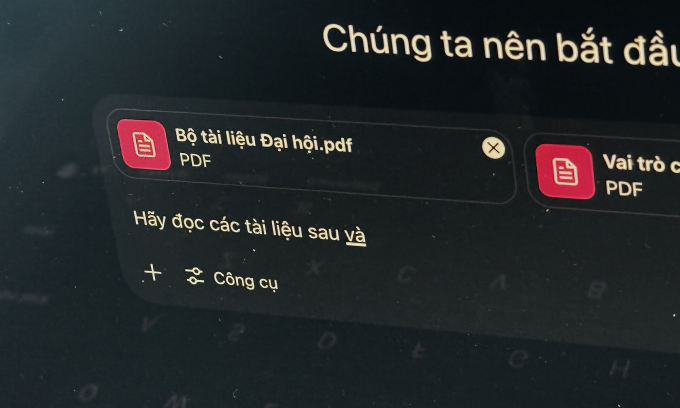

Thực tế, các chatbot AI phổ biến hiện nay như ChatGPT, Gemini, đều có điều khoản cho phép thu thập và lưu trữ dữ liệu người dùng nhập vào, nhằm phục vụ mục đích huấn luyện mô hình và cải thiện sản phẩm. Ở thiết lập mặc định, nội dung hội thoại, bao gồm văn bản, hình ảnh, tệp đính kèm, có thể được hệ thống lưu lại và phân tích, thậm chí có thể bị con người truy cập.

Điều khoản sử dụng ChatGPT với điều khoản sử dụng nội dung của người dùng. Ảnh chụp màn hình

Chẳng hạn với ChatGPT, dữ liệu người dùng từ các gói miễn phí mặc định được thu thập để huấn luyện AI. Với gói cao cấp, người dùng có thể tắt trong phần cài đặt hoặc sử dụng chế độ “Temporary Chat” để tránh lưu dữ liệu. Tuy nhiên, tính năng bảo vệ quyền riêng tư không được bật sẵn, khiến nhiều người không ý thức được rủi ro.

Trong khi đó, về mặt quy trình, đại diện NCA đánh giá hầu hết doanh nghiệp, tổ chức hiện nay chưa có quy trình sử dụng AI, như loại dữ liệu gì, tài liệu gì được dùng với AI, loại công việc nào cần tránh, từ đó sinh ra việc sử dụng tùy tiện và không kiểm soát. Công nghệ của các AI lớn cũng được đánh giá nằm ngoài phạm vi hiểu biết của phần lớn cơ quan, tổ chức sử dụng. “Họ quan tâm tới sự mạnh mẽ của AI mà ít tìm hiểu các yếu tố an toàn”, ông Sơn cho hay.

Làm sao để an toàn khi dùng AI?

Các chuyên gia đều đánh giá, để đối phó với Shadow AI, cần sự tham gia của cả doanh nghiệp và người sử dụng.

Theo ông Dũng, các tổ chức cần thiết lập chính sách và khung làm việc liên quan đến sử dụng AI có trách nhiệm. Ngoài ra, họ cần một giải pháp bảo mật AI toàn diện, có thể nhận diện ai đang sử dụng AI, các tài nguyên huấn luyện AI mà họ dùng, cũng như các công cụ đã được phê duyệt hoặc chưa được phê duyệt…

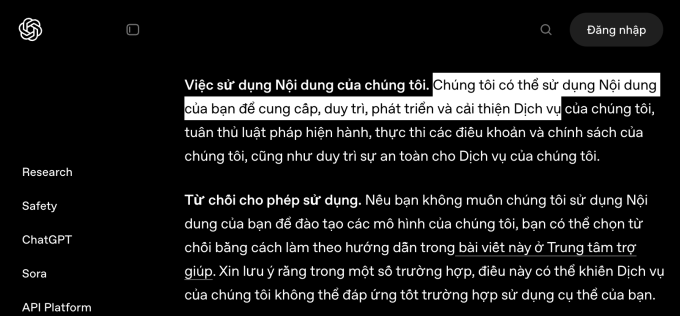

Một phóng viên dùng AI hỗ trợ chuyển từ giọng nói sang văn bản và tổng hợp nội dung. Ảnh: Lưu Quý

Chung nhận định, ông Vũ Ngọc Sơn cho rằng tổ chức, doanh nghiệp cần sớm có các nghiên cứu, ban hành chính sách, định hướng sử dụng AI an toàn, tăng đào tạo, giám sát theo đúng các quy định đã đặt ra.”Khi đưa dữ liệu nào lên AI, hãy xác định dữ liệu đó có thể được sử dụng rộng rãi, từ đó đánh giá mức độ ảnh hưởng để biết những thứ có nên hỏi hay không, hoặc khi hỏi cần mã hóa, xóa bỏ thông tin gì”, ông Sơn nói.

Ngoài ra, chuyên gia từ NCA cho rằng cần có sự tham gia của cơ quan quản lý trong việc sớm xây dựng tiêu chuẩn về các hệ thống AI được phép sử dụng, tùy theo mức độ quan trọng của hệ thống thông tin.

Trên thế giới, Shadow AI cũng là mối quan tâm của nhiều doanh nghiệp, quốc gia. Theo Axios, tại Mỹ, nỗi lo này trở nên lớn hơn khi DeepSeek giá rẻ ra mắt hồi đầu năm thu hút nhiều người sử dụng. Một số tổ chức đã cấm nhân viên sử dụng chatbot AI nhằm hạn chế nguy cơ rò rỉ thông tin.

“Việc nâng cao nhận thức cho nhân viên về rủi ro của Shadow AI rất quan trọng, đặc biệt khi chỉ có 55% người tham gia khảo sát tại Việt Nam cho rằng nhân viên của họ thực sự hiểu rõ các mối đe dọa liên quan đến AI”, ông Dũng cho biết.

Lưu Quý

https%3A%2F%2Fvnexpress.net%2Fshadow-ai-mat-toi-cua-thoi-dung-ai-khong-kiem-soat-4904726.html